你的位置:幸运5星彩app官方手机版 > 龙虎注 > 幸运5星彩app 10万引普林斯顿刘壮最新访谈: 架构没那么重要, 数据才是王说念

幸运5星彩app 10万引普林斯顿刘壮最新访谈: 架构没那么重要, 数据才是王说念

发布日期:2026-05-01 01:35 点击次数:50

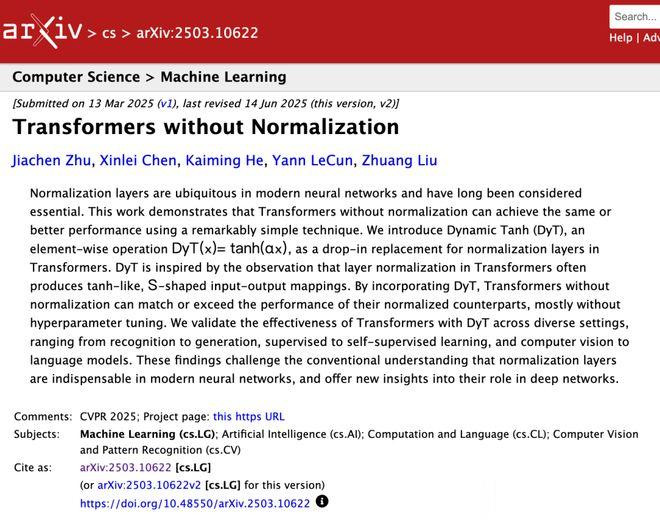

援用量卓绝10万次,清华姚班学友,ConvNeXt、ImageBind、《无归一化的Transformer》……这些论文的作家——

普林斯顿大学助理稳健刘壮,在学术圈是一个颇为特殊的存在——他的每一篇论文简直都在质疑某个“理所自然”的假定。

架构确切重要吗?数据集确切富有种种吗?归一化层是必需的吗?大言语模子有宇宙模子吗?AI智能体能替代博士生吗?

在《信息瓶颈》的最新播客中,刘壮和主捏东说念主RavidShwartz-Ziv、AllenRoush伸开了长达一个多小时的对谈,解答了这些问题。

刘壮给出了几个中枢判断(太长不看版)

1、架构选什么,没你想的重要

只消把残差联接、自提防力、归一化层、线性层这四大基础作念对,不管用ConvNet照旧Transformer,最终都会落在销毁条性能弧线上。

往时十年信得过激动AI逾越的,是更猛进度上是数据范畴和贪图范畴,而不仅仅架构转换。

2、数据集远莫得咱们以为的种种

他和何恺明作念了一个实验:稳健神经采集来判断一张图片来自哪个数据集。

赶走在三个堪称“种种化”的亿级数据集上,准确率高达80%以上——

证据这些数据集在模子眼里仍然口角分明,距离“无偏的全球分散”还差得远。

3、大言语模子有宇宙模子,但只在言语空间里

LLM在高头绪事件推理上阐扬出色,但视觉空间的良好宇宙模子咱们还莫得——

压根原因是视觉数据的信息密度太高,现存算力还处理不了

并且对于卓绝一半的使命场景(尤其是数字化的白领使命),压根不需要视觉宇宙模子。

4、挂念才是现时最大的瓶颈,不是才能

现存模子的推理才能依然富有强,信得过缺的是认识的历久挂念。

咱们需要那么多智能体配合,恰正是因为一个智能体记不住总计事情。

5、自主科研还没到位,AI替代不了筹商生

他亲自测试过让ClaudeCode在一两天内落寞完成一个筹商技俩。

论断是:低头绪任务还行,但建议专门想的问题、遐想实验、保捏标的感——这些还作念不到。

总计这个词访谈有一条荫藏的干线:咱们在AI规模里奉为圭臬的许多东西,其实是历史偶然。

而信得过决定成败的,往往是那些更朴素、更败兴的要素——数据、范畴、挂念

以下是量子位梳理的刘壮最新访谈,为便于领略,有部分删减和润色,并在必要的地点添加了编者注,诸位enjoy~

架构没那么重要,但细节决定一切

Ravid:今天咱们会聊聊你的一些论文。总体上,咱们要探讨咫尺AI中信得过重要的构成部分是什么。你的筹商效果许多,我想咱们可以从“哪些组件最重要”初始。

几年前,你发表了一篇对于“面向2020年代的卷积神经采集”的论文。你能先先容一下这篇论文,然后咱们再来拆解现时AI系统的各个构成部分吗?

刘壮:嗯,自然。那是一段格外敬爱敬爱的阅历。

这篇论文咱们是在2021年写的,那时候Transformer刚刚通过视觉Transformer的引入进入了贪图机视觉规模,总计这个词视觉社区都在从传统的卷积采集切换到视觉Transformer,性能也越来越好。

在这项使命中,咱们想筹商:ConvNet是否确切依然丧失了竞争力?

是否有可能通过系统性地放弃总计遐想细节,来考证ConvNet能否被当代化、达到其时视觉Transformer的水平?

咱们想搞瓦解,Transformer和ConvNet之间看似存在的性能差距,究竟是源于架构推行的不同——比如用自提防力照旧卷积——照旧源于一些看似眇小的遐想细节。

最终咱们发现谜底是后者。

经过无数对ConvNet各组件的筹商,咱们最终让模子在多种任务上达到了其时最强视觉Transformer的水平。

这证据,不管采用ConvNet照旧视觉Transformer,只消把总计细节都作念对,就能在视觉任务上达到同等的前沿性能。

Ravid:你现在还深信这小数吗?你还认为架构其实并不重要吗

刘壮:我不会这样说——总体上我倾向于招供,但我不会说架构不重要

我的敬爱是,只消你把总计细节都作念对,只消你对遐想空间探索得富有充分,就会敛迹到一个访佛“帕累托前沿”的点——在精度和遵循之间获取最好均衡。

要冲破这条前沿线长短常贫苦的。

我认为往时这样多年,除了几年前依然稳健的那些架构以外,信得过被凡俗选定的架构转换其实并未几。

不外这个探索经由自己格外敬爱敬爱。

最近,一些开源模子公司,比如Kimi、DeepSeek,还在连接折腾架构,比如如何改残差联接、如何联接不同层,我格外尊重这类使命。

事实上,学术界现在架构筹商没那么活跃,部分原因是咱们职守不升引富有劝服力的范畴来考证这些效果所需的贪图资源。

但我我方照旧会用学校的资源去尝试。现在有了ClaudeCode的匡助,我可以我方脱手写代码去探索,这格外敬爱敬爱。

从实用角度来看,我认为咱们用什么数据稳健模子,比采用什么架构更重要——前提是输入输出接口不变。

架构推行上是咱们参数化函数近似器的神气,这是神经采集或深度学习最基本的功能。

只消你把几件事作念对,比如用残差联接、用自提防力或其他合理的机制、在得当的位置放激活函数和前馈层,你就能格外接近以致达到性能与遵循的前沿弧线。

从推行专揽的角度,我认为更重要的是:这个模子用什么数据稳健的?它如何处理凹凸文和挂念?

在凹凸文和挂念这方面,如实有一些架构使命在照应这个问题。

我认为这才是让AI再上一个台阶最遑急需要照应的问题。

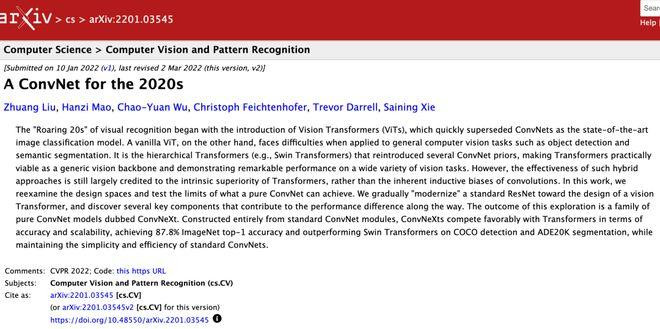

Allen:凭证我的领略,你们是把ResNet逐步往访佛SwinTransformer的遐想标的当代化,最终得到一个能与Transformer强力竞争的ConvNet。

在那篇论文里,哪一个消融实验最让你对“Transformer的上风究竟从何而来”改变了看法?

刘壮:哪一个?我认为是每一个。

你看那张图,莫得任何单一蜕变能大幅拉升性能。有些蜕变比其他的更有用,但莫得哪一个能改变一切。

ConvNeXt论文的Figure2,展示了ResNet当代化的完整经由和每一步对应的性能变化

也许激活函数的使用,以及减少归一化层的数目,是让我比拟感敬爱、也有明显性能进步的一个点。

但信得过起作用的是把总计蜕变洽商在一齐

这些看似眇小的组件,当咱们把它们组合起来的时候,产生的性能差距,是那种深广只消把卷积换成自提防力这种大蜕变才能带来的效果。

是以我认为,这篇论文最大的启示是:这些小细节组合在一齐,比那些看起来很中枢的采集组件影响更大

Ravid:对我来说,嗅觉咱们是在无数尝试各式东西,有些起效了,模子就变好了。然后回过甚来,咱们才初始信得过领略哪些组件是重要的。

你认为咱们是需要先有冲破,再回头领略细节?照旧说咱们只需要反复试错,不需要明确的标的?

刘壮:Transformer对总计这个词社区来说王人备是一个福音,把Transformer引入贪图机视觉这件事,真理紧要。

是那几年里王人备是最重要的冲破之一。

但视觉Transformer还有另一个公道,即是它已毕了文本和图像暗意的调处。

Transformer的使用对其后的发展格外重要,比如LLaVA,这类多模态框架——用视觉编码器把图像编码成token,然后和文本token一齐输入到下流的大言语模子里。

这是现在许多多模态模子的基本框架。

回到咱们的筹商,这种对细节的深远分析,我认为更像是一堂课。它改变了我我方的领略,也改变了许多东说念主的领略,这让我更引以为傲。

自然东说念主们照旧可以络续用ConvNet,它也有我方的上风,尤其是在纯视觉任务里:部署便捷,比拟容易领略,也因为操作是局部的,是以对更高分辨率和长序列有更好的支捏。

两种架构仅仅在不同地点各有长处。

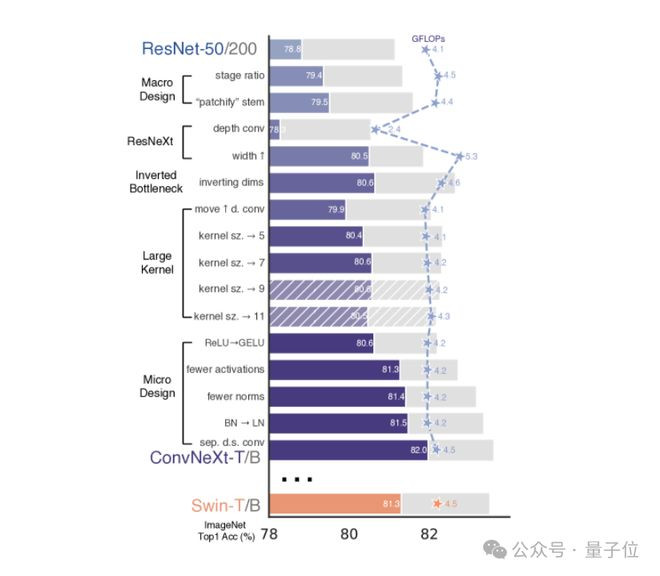

Ravid:好,架构不那么重要——你还有一篇更近的论文,讲明了归一化层也不那么重要,对吗?

基本上可以用双曲正切激活函数来取代归一化层,只需要一些调理,但效果一样好。

那你认为信得过重要的中枢组件是什么?并且为什么好的AI模子仅仅在最近五年才出现,而不是十年前?

刘壮:这是个好问题。

开始,Transformer大致是十年前建议来的,九年前吧。

是以在那之后很长一段时间里,咱们基本照旧沿用访佛的基本框架,只消一些小蜕变,比如激活层、巨匠羼杂(不是每次都用)、局部提防力、滑动窗口提防力等,但中枢框架和九年前论文刚出来时基本一样。

是以我的谜底是:数据,以及稳健时使用的贪图范畴

这就像GPT-1到GPT-3的经典故事——基本上是销毁个模子,用更多贪图量、更多数据、更种种化的数据、更大范畴的互联网数据来稳健,就得到了咱们现在看到的这些强盛才能。

是以我会把这归因于数据,其次是算力

我认为数据是主要要素,因为现在大多数模子稳健的epoch数都不卓绝一个。

Allen:我提防到你的筹商有一个辘集恒久的论点,即是这个规模频频把架构和稳健决议视销毁律。

要是你要为今天的架构论文设定例则,在有东说念主宣称某种架构采用有价值之前,你会要求哪些放弃条目?

刘壮:好,在盼愿宇宙里,咱们有无穷贪图资源,对吧?

开始,我会要求在一定例模上考证效果,不一定是前沿模子,但至少要在70亿、300亿参数这个量级。

范畴对工业界来说很重要,只消在这个范畴上,环球才确切会深信你的蜕变有用。自然,这并不老是可行的。

其次,要是你要在较小范畴上筹商架构变化,我会要求开始作念超参数搜索

你不可只在一组超参数下讲明新架构比旧架构好,尤其是当这组超参数是专门为这个新模子调过的。

每个模子都应该在各自最优的超参数下进行比拟,最重要的超参数是学习率、衰减、优化器类型。

让我很烦的一件事是,有东说念主以致不去调基线模子的学习率,只调我方步履的,然后就宣称有用——这是导致许多”赶走无法泛化”的最常见的问题所在。

第三,我会要求这个想法或步履在不啻一个数据集上得到考证,最好是在一个合理范畴的数据集上。

ImageNet今天仍然适用,但盼愿情况下,还应该在一些小范畴的大言语模子上考证,比如在FineWeb上稳健。

我格外讴颂在种种的数据集上考证想法,至少要在规模内常用的数据集上。这即是我会提的几个圭臬。

Ravid:要是一个想法是信得过好的,它是否应该在不同规模、不同数据集、不同场景下都有用?

照旧说有些格外好的想法只适用于格外特定的场景?

刘壮:我认为两种都相似有价值。

在第二种情况下,我但愿筹商者能瓦解地证据,这个步履在什么特定场景下更好,仍然应该在不啻一个数据集上考证。

要是你宣称你的模子在长凹凸文音频上效果更好,你仍然可以在这个方朝上用多个数据集测试。

同期要解释瓦解,为什么这个步履在这个特定规模好,为什么在其他规模不好,然后从这里登程,去照应那些缺陷。

这即是筹商的价值所在——你不需要第一步就全面得胜,那自然很好,但不是必须的。

数据集没你想的那么“种种”

Ravid:好,那咱们来聊聊数据。你说数据是最重要的。具体是数据的哪些方面?咱们先从你那篇对于“数据集偏差的几十年之争”的论文提及。你们的筹商动机是什么?

刘壮:这篇论文主要聚焦在视觉规模。

多年来,东说念主们一直在从越来越种种化的来源构建越来越大的数据集——从开始的MNIST,到CIFAR,再到ImageNet,再到互联网范畴的DataComp、Google的ConceptualCaptions等。

这些数据集看起来越来越种种,范畴从几万张到十亿级别。环球很自然地会认为:咱们依然网罗了互联网上能拿到的总计东西,数据集应该富有了吧?

但在咱们的初步实验里,咱们发现这些数据集相互之间其实相反极大。

咱们是如何估量的呢?咱们遐想了一个格外“蠢”的实验——从深度学习稳健的角度来看完全莫得推行真理。

咱们作念的是:给定三个很大的数据集,稳健一个神经采集来判断一张图片来自哪个数据集

这不是什么推行问题,仅仅想臆测图片的来源,是个多分类问题。

赶走发现,在这三个看似格外种种化的数据集上,模子仍然能以卓绝80%的准确率回答这个问题。

而当场臆测的准确率是33%,模子的准确率远远卓绝这个基线。

这意味着,在模子看来,这些数据集仍然格外不同,有格外瓦解的踪影让模子判断图片来自何处。

自然,咱们是在留出的考证集上作念测试,不是在稳健集上猜。

这促使咱们反想:咱们确切得胜构建了一个大范畴、全面笼罩的数据集了吗?什么样的数据才是终极办法?

这个“无偏的全球分散数据集”自己就很难界说,不同的东说念主可能有不同的圭臬。

大言语模子得胜的一个重要原因,是它不是规模专用的模子,它能作念总计事。要作念到这小数,一个普遍的假定是模子在稳健时需要见过总计东西。

但从这个初步实验来看,咱们明显还莫得达到阿谁进度。

Ravid:那你认为谜底是什么?好的数据需要具备哪些属性——种种性、不细目性、幸免冗余?

刘壮:是的,内容种种性、作风种种性……深度学习的一个大警戒是:

想让它擅长总计事,就要在总计事上稳健它。

但在咫尺的条目下,咱们仍然濒临量度问题——算力有限,模子容量有限。

模子学到的不同才能之间可能会互相竞争,比如要是你想让模子在编程上更好,可能就需要排除小数它在神志接洽方面的才能,这仅仅举个例子。

如何配比稳健数据,让每个咱们但愿模子擅长的规模都得到富有的暗意?这是一个重要的遐想问题。

在咱们最近一个翰墨转图像的技俩里,咱们发现了一个出东说念主料想的简便决议——不是最优的,但富有简便——即是把你暖热的总计规模大致等权重地羼杂

你不会但愿“如何剪发”和“如何编程”得到同等权重,因为它们对大多数东说念主的重要进度离别很大,你自然但愿模子在编程上见过更多数据。

但要是你把“剪发”扩张为“日常生活技艺”这个层面,把它和另一个同等重要进度的规模放在一齐,然后从每个规模网罗高质料数据并等权重羼杂,这种作念法在许多其他技俩里效果都可以。

Ravid:你认为这即是翌日的标的吗?即是把各式来源简便地羼杂在一齐?

刘壮:对于通用模子来说,是的。

要是你仅仅想让模子在总计事情上都还可以,而不是在某个特定贫苦任务上非常拔尖,那我认为数据笼罩是王说念

IlyaSutskever有句名言,疏漏是只消你有一个大模子,网罗了富有多的数据,模子就一定能训好

我认为这在当代深度学习里仍然适用。

迎面对用户时,想让模子在某个任务上阐扬好,就在稳健集里放富有多这方面的数据,这是最合理的照应决议。

视觉是桥梁,但言语先燃烧了这把火

AllenImageBind把六种模态对王人到销毁个镶嵌空间里。

你认为这是在证据视觉模态自己的特殊地位,照旧仅仅证据了视觉数据在大范畴数据中赶巧有这样的脚色?

刘壮:我认为这篇论文一个很重要的信息是:不同模态如实可以被镶嵌在一齐,这是现在多模态基础模子运作神气的基础

常见的作念法是用编码器把每个模态对王人到言语模子的token暗意。

ImageBind更专注于学习编码器自己,而不是把它们联接到大言语模子上。

另一个洞见是:视觉是联接总计模态的自然桥梁,因为视觉数据就像是咱们东说念主类的默许输入。

它时常和许多其他模态同期出现,比如音频——看YouTube视频时,音频和视觉数据自然地交融在一齐,你可以用这个信号来对王人两者。

还有领悟数据,也时常和图像或视觉数据同期出现。这揭示了视觉在咱们日常感知中的根人性地位。

Ravid:但为什么最终才能上的大跃升是通过言语模子已毕的?

咱们有视觉好一段时间了,但莫得看到AI在总计规模、总计公司里大范畴普及。直到言语模子变强,东说念主们才倏得初始用AI。

你认为这仅仅巧合,照旧言语自己有什么根人性的上风?

刘壮:是的,这是个被凡俗接洽的话题。

我的领略是:视觉推行上是浑沌量格外高的数据——它流入咱们感知系统的带宽远高于言语,而咱们还莫得富有的算力来信得过处理这些数据

想想看,就一帧图像,幸运五星彩手机官方app下载存储它所需的空间就浩大于用言语相貌这张图像——相貌可能只需要几个字节,图像却需要几千字节,出入上千倍。

是以一张图片的信息量如实卓绝一千个词。

另外,咱们也莫得好的机制让模子在图像上作念良好定位——在现时的多模态言语模子里,总计信息都依然编码在视觉token里了,模子莫得办法回头去重新聚焦图像的某个区域。

要是视觉编码器质料不好,自追忆模子对此毫无办法。

而言语处于一个低维得多的空间,每个词都有明确的含义——这有点像东说念主类从自然界里作念无监督学习。

咱们在进化经由中筛选出了这些重要观点,把它们凝缩成词,每个词只需要几个字节的存储空间,而用图像来暗意”杯子”这个观点,可能需要千千万万张图片。

处理这样无数信息所需的算力自然要高得多,我认为咱们咫尺还莫得到阿谁进度。

Allen:好,然后是那篇我很可爱标题的论文——《EyesWideShut》,斯坦利·库布里克的临了一部电影。

你在论文里建议,许多多模态大言语模子的失败,都可以追忆到CLIP这样的视觉编码器以及CLIP的盲点。

能详细一下这篇论文吗?在你看来,这个瓶颈究竟有若干是视觉问题,又有若干是言语模子或对王人问题?

刘壮:我认为这在很猛进度上是视觉编码器的问题

正如我之前说的,这些模子只会学稳健时教它们学的东西。要是稳健时莫得让模子面对你但愿它擅长的任务类型,测试时它就不会好。

具体来说,CLIP稳健的办法是让图像暗意和它的翰墨相貌对王人。而图像相貌自然地更关注图像的内容——里面有什么物体,它们在作念什么——而不太会明确证据这些物体的位置

要是图中有一个东说念主和一条狗,相貌无意只会说“东说念主和狗玩耍”,而不会说东说念主在左边照旧右边——这是咱们东说念主类相貌图像时很自然的神气。

对东说念主来说这没问题,咱们不太在乎谁在左边。但要是你但愿模子能够回答这类位置相关的问题,就需要在稳健里用到这些。而这正是CLIP稳健所忽略的。

赶走咱们得到一个被用作多模态言语模子视觉编码器的CLIP模子,它压根没被稳健行止理这些任务。

这再次印证了我的不雅点:想让模子擅长什么,就要在那件事上稳健它

Allen:在《EyesWideShut》那篇论文里,你建议把视觉特征和自监督特征羼杂来改善视觉定位。

要是同期优化言语对王人和细粒度视觉辩认,你认为多模态言语模子最盼愿的视觉编码器应该是什么样的?

刘壮:我现在心里想的照应决议即是两者都作念。这两种是现在视觉预稳健的两大主流范式。

我还想加一个——现在许多东说念主在接洽宇宙模子——我会在视觉部分加入时间维度,这也会格外有匡助。

大言语模子有宇宙模子,但只在言语空间里

Ravid:咱们来聊聊宇宙模子。你对宇宙模子的界说是什么?

刘壮:对我来说,宇宙模子即是预计宇宙如何运作,凭证你现时的景象来预计宇宙接下来会发生什么。

Ravid:这具体是什么敬爱?

比如几周前StephaneMallat来这里宣称大言语模子有宇宙模子,而之前YannLeCun来这里说咱们需要显式地构建宇宙模子,咫尺的大言语模子并莫得。

你如何看?你认为咱们能界说出一个圭臬,来判断哪些模子有宇宙模子、哪些莫得?

刘壮:是的,我认为大言语模子在言语空间里是有宇宙模子的,这毫无疑问。

言语是咱们所接管的总计感知信号的更高头绪的抽象,大言语模子在这个层面上有着相当好的宇宙模子。

我时常和ChatGPT接洽历史。几天前我让它遐想一个假定场景:中国历史上某个事件里,我让ChatGPT遐想要是阿谁失败的势力赢得了往返,历史会如何变?

它给出的回答格外合理——把总计小事件串联起来,一切都讲得通,仅仅一些小概率的决策偏移,然后一切随之改变,像委果历史一样,完全有可能即是委果历史。

在这个真理上,我认为莫得哪个演义家或历史学家能超越它在这串事件中的逻辑推理水平。

是以它们如实有一个很好的宇宙模子,只不外是在格外高的抽象头绪上

当咱们说“咱们现在莫得宇宙模子”,说的其实是视觉空间的宇宙模子——咱们没法在像素空间里完整地归附或模拟宇宙,这亦然确切。

我认为模子有莫得宇宙模子,取决于你想对宇宙的哪个头绪建模。

要是你把宇宙的高头绪事件视为一个自包含的宇宙,那咱们通过言语模子如实有。

但要是你把每个像素、每个原始信号、每个物理信号,包括宇宙上每种物资的物理属性,都纳入考量,那咱们如实还莫得阿谁头绪的良好化模子。

压根原因照旧视觉数据的浑沌量太高,咱们还莫得富有的算力来无缺地对它建模。

Ravid:那你认为咱们确切需要宇宙模子来照应99%的任务吗?

刘壮:对于数字化使命,比如白领使命,我认为不需要视觉宇宙模子。

许多事情都在数字空间里运作,我最多需要模子能读取我的电脑屏幕,而屏幕内容可以被数字化或压缩,深广最多是一组图像,不是及时视频流,这相对容易。

我咫尺用ClaudeCode的瓶颈之一即是需要截屏,这个问题应该很快可以照应,因为这些模子可能很快就能以安全的神气探望咱们的屏幕。

但对于膂力办事,比如建筑、驾驶、膂力行动,我认为如实需要视觉模子,因为这类使命中的反应长短常细粒度的。

还有剪发——你想剪哪部分头发、剪若干,这是没法靠言语模子来完成的。

还有一些物感性的使命,比如外科手术。我认为,信得过需要视觉宇宙模子才能作念好的使命,不会卓绝一半

挂念才是信得过的瓶颈,智能体仅仅权宜之策

Ravid:你如何看强化学习?

现在总计实验室都在建我方的环境,想在编程或某些特定任务上作念得更好,就搭一个专用环境,让模子在这个环境里稳健,给它反应和奖励。

你认为这是翌日的标的吗?

刘壮:是的,推行上我不细目每个实验室都这样作念强化学习或监督微调是否确切可行。

我但愿翌日能有一套像预稳健一样稳健的步履来作念捏续稳健。可以是强化学习,也可以是情境工程、指示工程、智能体配合,这些都照旧绽放的。

也许还需要调理架构,让模子有更大的挂念、更长的凹凸文。

捏续学习这件事,把通用模子适配到特定规模,我认为格外重要。

因为每个东说念主在一世中会际遇不同的情境。你但愿模子成为你的好助手,赋能你的生活和使命,你需要它记取无数凹凸文。

在这方面,东说念主脑仍然远超模子——极大的挂念容量,快速学习,只需见一次就能记取一个事实,并且不会健忘。

你今天用ClaudeCode时,最让我惦记的即是它是否还牢记我之前作念过的事,我深信许多东说念主都有这个感受。

在咱们各自的工作生存里,有太多东西但愿模子记取,毋庸每次都重新解释。

不是什么特定任务,而是总计一切——咱们与他东说念主的互动神气、往时的成就和失败等等。

我认为这个谜底可能不仅仅强化学习,更像是系统工程——如何组织一切,让模子能粗拙探望所需信息。

说到底照旧数据问题:如何组织数据,如何提供富有的数据,如何整合来自不同来源、不同输入的数据。也许以后咱们会戴智能眼镜,给这些模子提供视觉输入。

Ravid:但你认为基本的组件依然到位了,照旧会保捏不变?

咱们仅仅需要搭好脚手架——比如如何让智能体活着界里行动、网罗数据、组织挂念这些事情?照旧说咱们需要从压根上改变什么?

刘壮:是的,这是个很好的问题。

有一个令东说念主缺憾的现实是:不是每个东说念主都能在这些超大模子的基础层面上作念筹商,只消职守得起稳健老本的东说念主才能作念实验。

是以现在咱们看到无数的智能体使命——因为这简直是许多东说念主能对系统作念出改良的惟一神气。

智能体很好,但我提防到,我构建的每一套智能体系统,每一个脚手架——比如我试图搭一个能让ClaudeCode长时间运行的框架——

深广过几周或几个月,我会找到一个更简便的照应决议,比如用指示或一些内置敕令和技艺来已毕相似的效果,而不需要Python脚手架这类东西。

是以我认为最大的警戒是:保捏系统简便,让模子我方作念许多决定

缺憾的是,不是每个东说念主都能为底层模子才能的进步作念孝顺。

咱们能作念的是情境工程和智能体。但在基础才能方面,我认为咱们仍然可以追逐。

咱们现在暖热的每一个任务,在一定的性能水平上,都可以用更少的智能体、更少的脚手架来完成,而更多地依赖模子自己的才能。

我认为咱们仍然处在这条弧线上。

Ravid:但咱们为什么要介意呢?在算力和数据越来越多的宇宙里,为什么不就平直搭智能体照应总计问题?

刘壮智能体照旧会犯错——代码智能体亦然。

我际遇的许多失实都是因为它记不住某些东西,这很明显,应该是了然于目的。

是以我认为在挂念方面——挂念和凹凸文——这是咫尺最重要的问题,尤其是挂念。它们是一枚硬币的两面。

即使你有无穷的凹凸文,要是它健忘了或者记错了事实,它的挂念力仍然不好。

ClaudeCode前几天晓示支捏100万token的凹凸文窗口,环球都很奋斗,包括我,这很好。

但咱们如何才能领有无穷的挂念?至少是捏续学习问题——如何才能不健忘?

我认为这比如何构建配合智能体更重要,要是咱们在这方面获取冲破,会更有价值。

咱们需要许多智能体,恰正是因为一个智能体记不住总计事情,需要拆分任务。

要是一个智能体能记取总计事情,作念完这个任务还不健忘上一个任务,那总计使命就可以交给这一个智能体完成。

看成个东说念主助手,有一个能记取总计事情的助手,总比和谐多个智能体更便捷。

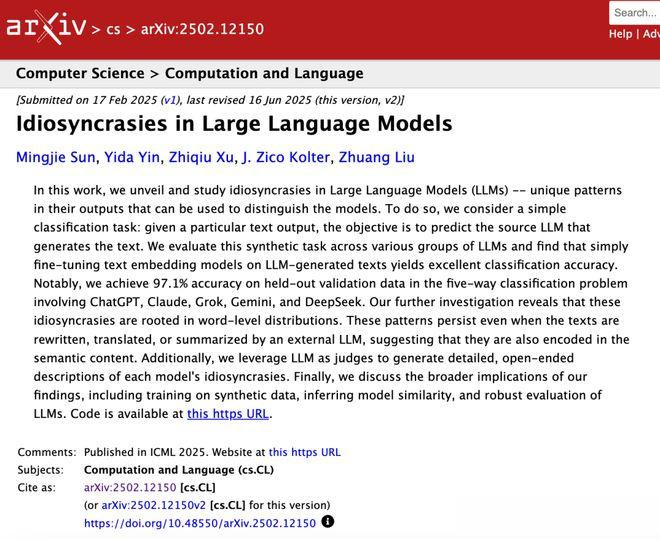

Allen:你还有一篇我很感敬爱的论文——《大言语模子中的特异性》,发现模子独到的特征在改写、翻译、撮要之后仍然保留。

你认为这些“指纹”到底在度量什么?是预稳健数据、稳健后的作风、解码行动,照旧更底层的结构性要素?

刘壮:这篇论文作念的是相似的分类任务——给定一段文本,让一个落寞的神经采集判断它是由哪个言语模子生成的。

咱们发现准确率可以格外高,在五个候选模子的情况下可以达到99%。

其时对咱们来说也挺出乎料想的。

但现在我认为环球越来越禁受一件事:言语模子生成的文本里如实存在踪影,即使不是AI筹商者的普通东说念主也能判断出无意是哪个模子写的。

现在这不再那么令东说念主骇怪了,因为每家公司都有我方的战术来最大化用户参与度,导致模子输出了不同的作风。

到底是什么变成了这些相反?我认为每家提供商对作风的采用格外重要——系统指示,咱们看不到他们的系统指示,他们有莫得让模子输出可贵或简陋,有莫得用列表?

后稳健战术也有很大影响,不同公司的后稳健神气不同,他们招募标注员的神气、评分圭臬都会有系统性相反,这些都会饱读舞不同的行动方式。

预稳健也有影响,每家公司的预稳健数据来源不同,有些侧重编程和数学推理,有些优化通用常识笼罩。

令东说念主缺憾的是,咱们不知说念这些相反各自孝顺若干。

总体来说,我认为后稳健和系统指示的遐想是变成相反的主要原因,占大部分比重。

Ravid:你如何看预稳健这件事?预稳健、中稳健、后稳健这种分歧会络续存在吗?

刘壮:我认为预稳健和中稳健相互更相似,都和后稳健有所不同。

后稳健的奖励信号是不同的,因为它波及到东说念主类判断和东说念主类偏好。

预稳健和中稳健推行上都是自追忆,仅仅数据作风和凹凸文长度不同。

中稳健是个比拟新的观点,几年前咱们只消预稳健和后稳健,现在多了一个中稳健。

中稳健无意是一种临时景象,因为中稳健的中枢是扩张凹凸文长度、引入更高质料的数据

我莫得这些公司的里面信息,但我认为这可能是一种息争——咱们莫得富有的算力恒久在超长凹凸文上稳健、恒久在最高质料数据上稳健。

是以预稳健和中稳健可以统称为“预稳健”,引号里的那种。

后稳健不同,因为它波及东说念主类对模子行动的主动指引,这种区别不会消散。

但我但愿翌日还有另一个阶段——针对每个用户定制的捏续稳健,定制偏好、挂念需求、使用作风,那会格外好。

Ravid:你如何看捏续学习?是像自监督学习那样从不同视角的相反里学习?

照旧针对特定任务,有了新数据再照应特定问题?

刘壮:我认为捏续学习不太是对于增强才能的。我更闲散把它看作更好的挂念。

这些模子已有的才能依然很好了,它们能解出大多数东说念主解不了的数学题。

咱们需要的是让模子记取每个东说念主的个性民俗——我会如何复兴某些事件?我有哪些基本原则?

即使我把我方生活里总计的阅历和偏好都写在一个Markdown文献里,它照旧可能遗漏。

比如我现在有一个全局的ClaudeMD文献,告诉模子际遇某些情况时要提防什么,但它们时常照旧会忽略。

我莫得好的办法让这些内容信得过“粘”在模子上。

是以我一直认为,捏续预稳健更多是对于领有认识的挂念、不在小事上犯错,而不是发展更多才能

是找到在得当场景下使用正确技艺的才能,而不是发展更强盛的技艺。

Ravid:你如何看这件事?

我好像在LinkedIn或Twitter上看到有东说念主说,有了新的编程智能体,他不再需要学生了,平直告诉智能体想作念什么,让它跑实验、出赶走、写阐发就行了。

你认为咱们会看到更多学生照旧更少学生?

刘壮:从汲引角度来说,我认为咱们需要更多深度参预其中的学生,需要能够使用AI并进一步激动AI发展的学生。这小数不应该有什么争议。

从推行技俩的角度,我认为谜底是一样的。

只消有合理的资源和时间,我现在可以用ClaudeCode我方作念一个小技俩。但这不是全自动的。

我也曾让它在一两天内落寞完成一个技俩,从构猜测实验到写论文,但效果不好——

建议的问题很疲塌,对我来说没什么敬爱;作念的实验不够全面,仅仅对付能复古论断;我需要反复指示才能把它引到正确的标的。

它健忘事情的频率也超出我的预期。我让它一直用某个GPU分区,它可能治服几个小时,任务完成后就忘了。

我但愿它永不断歇,凭证现时实验赶走连接探索、遐想下一个实验测试新假定,但它即是不听,有时候会堕入局部最优。

是以我认为它们擅长低头绪的任务,在更高头绪的筹商领略和导航上还不够好

学生也可以像我一样,让ClaudeCode帮我方提高使命遵循。

并且要是他们有正确的心态,不把总计事情都录用给AI,他们仍然会在这个经由中成长,成为好的筹商者。

我认为咱们需要更多这样的学生,不是更少。

Ravid:你据说过吗,AndrejKarpathy发布了AutoResearch,即是给一个代码智能体去优化NanoGPT,让它连夜跑多个实验,赶走考证亏空如实鄙人降。

刘壮:对,对。

Ravid:智能体建议的一个建议是改变当场种子,然后赶走就变好了许多。

我我方也试过访佛的事,即是对这个技俩作念了个很简便的贝叶斯优化,超参数搜索。

赶走发现用更少的迭代次数、更短的时间就能得到更好的赶走。

我认为最终咱们需要搞瓦解,哪些用法信得过有用,哪些还没到位,哪些仅仅因为看起来娴雅、环球都用,是以咱们在败坏时间去指示它。

刘壮:嗯。

Ravid:是以,我情愿你的判断,自主筹商咫尺还没到阿谁阶段。

翌日会不会到,我不知说念,也许会。但至少对某些场景,对某些用途,用来成立居品依然相当可以、接近可用了。

刘壮:嗯,嗯。

Ravid:但在筹商方面,还没到。

刘壮:如实幸运5星彩app,这亦然我的躬行体验。

江南体育(JNsports)官网app下载